【AI最新動向】TSMCの巨額投資が示す需要の行方と、Anthropicが引き起こす「バグ・アルマゲドン」

本記事は、Wall Street Journal(2026年4月14日付)の “TSMC Shows Where AI Demand is Headed” を参考にしつつ、私自身の視点で再構成したものです。

🔗TSMC Shows Where AI Demand is Headed

AIが「熟練の科学者の直感」を論理的に再現し始めた時、私たちはどのような役割を担うべきだと思いますか?

TSMCの直近の売上高が約17兆円であり、AIが一過性のブームではないと言い切れるので更なる半導体需要が売上を押し上げ20兆円超えも遠くないでしょう。この記事が言いたいことは、ソフトの需要に応えるためのハード側適合のための設備投資と売上見通しということです。

記事要約

1.TSMCの投資計画に見るAI需要の「本気度」

世界最大の半導体受託製造企業(ファウンドリ)であるTSMCの動向は、AI需要の正確な先行指標となっている。同社は今年の設備投資額(Capex)を、市場予想を大幅に上回る520億〜560億ドル(約8兆円規模)と予測。これは過去5年間の平均より60%以上も高い水準だ。

半導体製造ラインの稼働率低下は経営に直撃するため、この強気な投資は、AIブームが一時的なものではないという同社の自信の表れと言える。

2.計算リソースの枯渇とMetaの復活

AIの急速な普及により、不可欠なリソースである「コンピューティング・パワー(計算能力)」が世界的に不足している。一方で、企業側の業績は堅調だ。

Meta(旧Facebook): 3月にSNSの有害性に関する訴訟で敗訴し株価を下げたが、新型AIモデル「Muse Spark」の発表により株価は完全に回復。2026年の広告収入は2,435億ドルに達し、Googleを上回ると予測されている。

3.Anthropicの新型AIが招く「バグ・アルマゲドン」

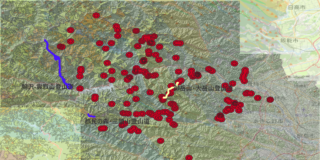

Anthropic社の最新モデル「Mythos」が、27年間見逃されていた深刻なソフトウェア・バグを発見した。AIが超高速で古いコードの欠陥を見つけ出すようになったことで、セキュリティの向上に寄与する反面、報告されるバグの膨大な量に小規模な開発者が対応しきれなくなる「バグ・アルマゲドン(バグによる終焉)」の懸念が浮上している。

要点チェック(数字で見るAI)

- 520億〜560億ドル: TSMCの2026年設備投資予定額。

- 65%: TSMCが第1四半期に達成すると予測される過去20年で最高の売上高総利益率。

- 2,435億ドル: Metaの今年の予測広告収入。

- 27年: AnthropicのAIが発見した潜伏バグの期間。

Editor’s Note

AnthropicのAIは文章の表現力や長文の要約、コーディングに強いが情報収集力が弱くベースとなるデータが1年前までの状況と聞いている。今回のバグを発見できたのは情報収集力とは関係ないということなのか?

今回のバグ発見は「情報収集力(ネットから新しい情報を取ってくる力)」というよりも、Anthropicのモデルが持つ「論理的推論能力」と「コードの構造を深く理解する力」による功績といえます。

Anthropicのどんな能力が効果を発揮したのか

なぜ情報収集力とは別の話なのか、3つのポイントで解説します。

1.27年間「誰も気づかなかった」ものを解析した

今回のバグは、27年もの間、世界中のエンジニアや既存のチェックツールをすり抜けてきたものです。つまり、「答え」がどこにも載っていない問題でした。

ネット上の情報を検索して持ってくる能力(情報収集力)が高くても、答えがどこにも存在しない以上、検索では解決できません。AIが自らソースコードを一行ずつ精査し、「この処理の後にこの操作が来ると、論理的に破綻する」という矛盾を自力で見つけ出す思考の深さが鍵となりました。

2.「文脈(コンテキスト)」の把握能力

Anthropicのモデル(Claudeシリーズや今回のMythos)は、非常に長い文章やコードを一度に読み込む能力(コンテキストウィンドウの広さ)に長けています。断片的な修正ではなく、システム全体の膨大なコードのつながりを把握できる。

「Aというファイルでの処理が、巡り巡ってZというファイルの脆弱性に繋がる」という遠く離れた因果関係を特定できた。これは、情報の「収集」ではなく、手元にある膨大な情報の「整理・分析」の能力です。

3.コーディング能力の延長線上にある「デバッグ力」

Anthropicはコーディングに強い特性があります。優れたコーディング能力とは、単にコードを書くだけでなく、「プログラムが動く論理的なステップを完璧にシミュレーションできる」ことです。今回の「バグ・アルマゲドン」の引き金となったのは、AIが人間以上に厳密な「デバッグ(校正)」を、人間には不可能なスピードと規模で実行し始めたことにあります。

補足:今後の懸念(バグ・アルマゲドン)

情報収集力とは関係ないからこそ、事態は深刻です。AIが自ら考えてバグを見つけすぎるため、以下の状況が生まれています。

- 発見の高速化: 人間が一生かけても見つけられないバグを、AIは数秒で見つける。

- 対応のパンク: 修正案まで提示されるものの、その内容を精査して反映させる「人間のエンジニア」の数が足りず、管理が追いつかなくなる。

つまり、今回の件は「AIが物知りになった」のではなく、「AIが超天才的なデバッガー(校正者)になった」ことで起きた現象と言えます。

Anthropicの解釈可能性(Interpretability)

創業哲学と言ってもいいくらいAnthropicが拘っている領域です。研究者が社員数の30%強もいてOPEN AIの5%程度とは決定的に違います。

Anthropicが社を挙げて取り組んでいる「解釈可能性(Interpretability)」、特に「機械論的解釈可能性(Mechanistic Interpretability)」の研究成果が、モデルの精度向上に大きく寄与していると考えられます。

なぜ「解釈可能性」への注力が、今回のバグ発見のような強みにつながるのか、その理由を深掘りしてみます。

「ブラックボックス」の中身を理解する技術

多くのAI開発が「より賢く、より巨大に」という方向に進む中、Anthropicは「AIがなぜその答えを出したのか」という内部プロセスを解明することに執念を燃やしています。

- AIの内部にある「特定の概念(例:セキュリティの脆弱性、論理的矛盾)」に反応するニューロンのような仕組みを特定する。

- その仕組みを強化・調整することで、人間でも見逃すような微細なコードのパターン(27年間隠れていたバグなど)を正確に捉える「検知器」としての精度を極限まで高めています。

予測ではなく「論理の検証」

一般的なAIは「次に続くもっともらしい言葉」を予測しますが、解釈可能性を重視して訓練されたモデルは、より「論理的な一貫性」を保とうとします。

- コーディングにおいて、単に「動きそうなコード」を書くのではなく、内部で論理的な検証を行いながら処理を組み立てる。

- その結果、コードの表層的な書き方ではなく、「構造的な欠陥」を見抜く力が他社モデルよりも鋭くなっているのがAnthropicの特徴です。

安全性(AI Safety)へのこだわり

Anthropicは「憲法AI(Constitutional AI)」という手法を用いて、AIに明確なルールや倫理観を持たせています。

- 「安全で信頼できるコードとは何か」という定義を深く学習させている。

- この「安全第一」という設計思想が、結果として「脆弱性(バグ)を見つけ出す」という防衛的な能力(サイバーセキュリティ能力)を飛躍的に向上させました。

結論

今回の「バグ・アルマゲドン」を引き起こした圧倒的なデバッグ能力は、単なる偶然や情報の多さではなく、彼らが提唱する「AIの中身を理解し、制御する(解釈可能性)」という哲学の勝利と言えるかもしれません。

「中身がわかるからこそ、より正確に、より深く解析できる」というわけですね。

科学と化学の研究開発にかなりの影響を与える?

AIが「なぜその結論に至ったか」を論理的に説明できる、あるいは高度な論理矛盾を見抜けるようになることは、科学(Science)と化学(Chemistry)の分野において、これまでの「数打ちゃ当たる」式の研究スタイルを根本から変えるポテンシャルを秘めています。

具体的にどのような影響が考えられるか、3つの視点で整理しました。

1. 仮説検証の高速化と「死に筋」の回避

これまでの研究開発(特に新素材や新薬の開発)は、膨大なパターンの実験を繰り返し、失敗の中から正解を見つける「エジソン型」のアプローチが主流でした。

- 論理的なフィルタリング: Anthropicのような解釈可能性に強いAIは、「この化学結合のシミュレーションは、熱力学のこの法則と矛盾する可能性がある」といった高次元のチェックを、実験前に行うことができます。

- 「なぜ失敗したか」の解析: 実験データから、人間には見えない微細な因果関係を解釈し、次の実験への正確なフィードバックを提供します。

2. 論文の「再現性問題」への終止符

科学界では、他人の論文の実験を再現できない「再現性危機」が長年の課題です。

- 隠れた前提の抽出: 論文の記述に含まれる論理的な飛躍や、記述されていない実験条件の矛盾をAIが見抜くようになります。今回の27年前のバグ発見と同様に、過去の膨大な論文の中から「理論的な欠陥」を次々と指摘し、科学的知識の「大掃除」が始まるかもしれません。

3. 未知の物質・反応の「予言」

情報収集力だけでなく「構造を理解する力」が強いAIは、既存のデータの延長線上にはない、全く新しい物質の構造を提案できます。

- 化学のバグ取り: 「この分子構造は理論上安定しているはずだが、実は内部で反発が起きる」といった、既存のシミュレーションソフトが見逃していた「理論のバグ」をAIが指摘することで、化学理論そのものがアップデートされる可能性があります。

「バグ・アルマゲドン」ならぬ「サイエンス・ビッグバン」

ソフトウェアの世界で起きた「バグ・アルマゲドン」は、科学の世界では「偽りの理論の崩壊」と「真の発見の加速」を意味します。

あまりのスピードに人間の科学者が査読や検証を追いつけなくなるという、ソフトウェア開発者と同じような「嬉しい悲鳴」が、近い将来ラボからも聞こえてきそうです。

イラン作戦(Operation Epic Fury)におけるAnthropicのAI「Claude」活用

トランプ大統領の禁止命令を押し切ってまでAnthropicのAI「Claude」を活用したというニュースは、まさにその「正確性」と「論理的推論」への信頼を物語っています。

1. 「情報の質」を補う非公開データの存在

一般向けのClaudeは最新のネット検索能力を制限している場合がありますが、米軍やインテリジェンス・コミュニティ(CIA等)が使用するモデルは、「エアギャップ(外部から遮断された)」環境で、独自の極秘データを直接読み込ませた特装版です。

- CIA・NSAの生データ: 衛星写真の解析、通信傍受(SIGINT)、現地の人間諜報(HUMINT)など、ネットには落ちていない「最高密度の情報」をAIに直接処理させています。

- 情報の鮮度問題の解決: AI自体が検索するのではなく、軍のシステムがリアルタイムで収集した情報をAIの「コンテキスト(作業メモリ)」に流し込むことで、最新状況に基づいたシミュレーションを可能にしています。

2. なぜ「正確性」が重要だったのか

イランのような大国との紛争では、一歩間違えれば核戦争や世界大戦に発展しかねません。

- 誤爆の回避: ターゲット選定において、情報の断片から「民間施設か軍事施設か」を論理的に切り分ける能力が必要です。Anthropicのモデルが持つ「解釈可能性」は、AIがなぜそこをターゲットと判断したかのプロセスを人間に説明できるため、司令官の最終判断に高い根拠を与えました。

- 「ハルシネーション(嘘)」への耐性: OpenAI等の他社モデルと比較して、Anthropicは「わからないことはわからない」と答え、事実に基づかない推測を避ける傾向(安全性・誠実性)が強いと評価されています。これが、情報の不確かな戦場では「信頼」に繋がりました。

3. 「バグ発見能力」の軍事転用

前述した「27年前のバグを見つける能力」は、軍事的には「相手の防衛システムの穴を見つける能力」に直結します。

- イランの防空網やインフラを制御するソフトウェアの脆弱性を、AIが数秒で特定し、サイバー攻撃と物理攻撃を組み合わせるシミュレーションを行っていたと報じられています。

結論:情報量よりも「情報の料理法」

米国政府は、「ネット上の不確かな大量情報(OpenAIが得意)」よりも、「手元にある確かな機密情報を、いかに論理破綻なく正確に解析できるか(Anthropicが得意)」を重視したと言えます。

しかし、この「正確すぎるAI」の活用を巡っては、トランプ政権と国防総省の間で激しい対立が起きており、Anthropicが「殺傷目的の利用」を拒んだことで、現在は軍のAI調達がOpenAIへとシフトしつつあるという皮肉な展開も見せています。